1. Introducción

El interés de la comunidad académica se ha centrado en la adquisición, promoción y evaluación de las competencias necesarias en y para la investigación en estudiantes universitarios de diversas áreas del conocimiento. Esta tendencia ha contribuido a emprender estudios que han permitido la caracterización de esta competencia, así como proponer metodologías para su estudio en educación superior (Ianni et al., 2019; Paz y Estrada, 2022; ValdiviezoVillegas et al., 2023; Sandoval-Henríquez y SáezDelgado, 2023). Los conocimientos, habilidades y actitudes relacionados con la labor científica son considerados fundamentales dentro de los proyectos curriculares y formativos de las universidades e instituciones de educación superior, especialmente debido a su repercusión en el eventual ejercicio profesional de los estudiantes, el avance científico de los campos de estudio y la contribución al impulso tanto económico como socio-cultural a nivel regional y nacional (Ciraso-Calí et al., 2022; Colás-Bravo y Hernández, 2021). La competencia investigativa es un constructo polisémico y multifactorial que admite diversas aproximaciones para determinar los conocimientos, habilidades, actitudes y valores que la constituyen. Algunos componentes, señala ColásBravo y Hernández (2021), incluyen la resolución de problemas, creatividad, habilidades argumentativas y pensamiento crítico. A ello, Castillo-Martínez et al. (2021) añaden el dominio sobre los diseños y enfoques de investigación, así como de técnicas y estrategias de recolección y análisis de datos. Por su parte, Ciras-Calí et al. (2022) incorporan la comprensión de principios, conceptos y procesos clave de la disciplina desde cual se investiga.

De manera generalizada, la competencia investigativa remite al conjunto de componentes meta-cognitivos, cognitivos, metodológicos, operativos y afectivo-actitudinales utilizados de manera autónoma y flexible por el estudiante con el fin de identificar, resolver e informar sobre problemáticas desde una disciplina específica (Espinoza et al., 2016; Estrada, 2014; Martínez-Rizo, 2019; Sandoval-Henríquez y Sáez-Delgado, 2023; Villa, 2005). La adquisición y promoción de esta competencia está influenciada por el desempeño del estudiante, la intervención pedagógica del docente y los objetivos curriculares de los proyectos formativos de las universidades (Hernández et al., 2019). Por ello, sostiene Cardoza et al. (2023), es necesario la formulación de políticas, programas y estrategias orientadas a la evaluación de estas competencias en el ámbito universitario. Estas prácticas evaluativas se fundamentan en modelos de evaluación distinguidos por perspectivas teóricas sobre el proceso enseñanza-aprendizaje y metodologías con implicaciones en sus aplicaciones y usos (Mellado-Moreno et al., 2021; Moreno-Olivos, 2021).

En el campo de la evaluación educativa, una de las líneas de investigación consolidadas es aquella dirigida a valorar e informar sobre la adquisición y progreso de las competencias desarrolladas por el estudiante universitario durante su formación profesional. Esto se ve reflejado en la amplia producción académica en torno a modelos, técnicas e instrumentos para la evaluación basada en competencias en contextos escolares (Boritz y Carnaghan, 2003; Mejía, 2012; García-Cabrero y Ledesma, 2022; Manzanares y Sánchez-Santamaría, 2016). Uno de los retos persistentes en la evaluación de competencias profesionales es establecer cómo medir su rendimiento y desempeño.

La función principal de los instrumentos de medición en los procesos evaluativos es generar una medida que proporcione información relevante sobre el constructo de interés. Esta información es fundamental para respaldar la toma de decisiones de acuerdo con los objetivos y finalidades del programa de evaluación. En ese sentido, su objetivo es proporcionar puntajes o valores de las variables del constructo objeto de evaluación que permitan interpretaciones precisas y acordes a los propósitos de la evaluación. Dada la importancia de estos instrumentos en evaluaciones tanto sumativas como formativas, su diseño y desarrollo deben seguir lineamientos o estándares reconocidos por la comunidad académica para asegurar su calidad conceptual y técnica (e. g. AERA, APA y NCME, 2018; Downing y Haladyna, 2011; Geisinger et al., 2013; Lane et al., 2016). Algunos aspectos clave en su elaboración incluyen el uso propuesto, población objetivo, conceptualización del constructo, formato del instrumento y la generación de evidencias de validez.

El uso propuesto implica declarar de manera explícita y clara cómo se prevé que la información proporcionada por el instrumento será interpretada y utilizada. Por ejemplo, en la toma de decisiones sobre la admisión de estudiantes, monitorear el rendimiento académico, perfeccionar el desempeño académico o el desarrollo de intervenciones pedagógicas (Linn, 2010). Este uso o propósito del instrumento tiene un impacto significativo en la validez de las inferencias y conclusiones a las que se pueden arribar (Hattie y Leeson, 2013). Otro aspecto importante es la delimitación de la población objetivo, es decir especificar quiénes conforman el grupo previsto de examinados o sustentantes. Esto proporciona un panorama para el proceso de muestreo y es crucial para la aplicabilidad, representatividad y generalización de los resultados (AERA, APA y NCME, 2018).

Uno de los principales desafíos de la evaluación educativa radica en la conceptualización del constructo que se pretende medir. Las definiciones teóricas y operacionales del constructo representan un marco conceptual que señala los componentes clave del constructo de interés, como conocimientos, habilidades o comportamientos. Estos últimos se enuncian en forma de indicadores, de manera que cada componente pueda ser capturado o registrado mediante un instrumento. Dado que la competencia investigativa, al igual que otros constructos en la investigación educativa, tiene una naturaleza compleja y multidimensional su definición conceptual y operacional debe derivar de estudios sistemáticos para identificar y seleccionar los componentes que la integran (Jornet et al., 2011; Lane et al., 2016b).

Este marco de referencia sirve como punto de partida para la selección del formato del instrumento, que varía según el tipo de información o resultado que se espera generar, su propósito, administración, así como sus modos de operación. Estos se clasifican en pruebas, cuestionarios, inventarios de auto-informe, escalas, rúbricas de observación, portafolios entre otros (Ary et al., 2010). La elección de cuál utilizar depende de su pertinencia y adecuación para capturar de manera más efectiva los indicadores establecidos en el marco de referencia.

Finalmente, la generación de evidencias de validez es un proceso fundamental para garantizar tanto la calidad conceptual como técnica de los instrumentos de medición y de los procesos evaluativos en el campo educativo. En la actualidad, este proceso se conduce desde un enfoque argumentativo (AERA, APA y NCME, 2018). Bajo esta perspectiva, la validez no refiere únicamente al valor numérico obtenido por un índice o prueba estadística, sino a la consistencia y coherencia de las evidencias generadas para respaldar las inferencias y usos de los resultados del instrumento (Kane, 1992; 2013; Ramos, 2015). Estas evidencias derivan de análisis empíricos y lógicos sobre la información recolectada para tal fin (AERA, APA y NCME, 2018) como índices de consistencia interna o procesos de alineación. En otras palabras, se refiere al conjunto de evidencias recopiladas desde diversas fuentes y mediante diferentes estrategias de análisis para fundamentar las inferencias y usos de los resultados del instrumento según la finalidad del programa de evaluación.

La investigación educativa, como campo interdisciplinario, provee diversos instrumentos para informar sobre la adquisición, dominio y desempeño de competencias entre estudiantes universitarios. Además, la literatura especializada sobre las variables de la competencia investigativa, las intervenciones dirigidas a mejorarla y su evaluación es amplia y puntualmente documentada. Una aproximación sistemática para sintetizar e integrar este corpus de información con el fin de ofrecer un panorama sobre sus avances y estado actual son las revisiones sistemáticas de la literatura (Sandelowski y Barroso, 2007; Paterson, 2012).

Específicamente, se han conducido estudios desde esa aproximación para identificar los diversos componentes que abarca la competencia investigativa (e. g.Valderrama et al., 2022), explorar cómo se ha estudiado (e. g.Valdiviezo-Villegas y Leyva-Aguilar, 2023; Sandoval-Henríquez y Sáez-Delgado, 2023) o analizar los instrumentos aplicados para informar de tal competencia en disciplinas como medicina o enfermería (e. g. Ianni et al., 2021; Chen et al., 2021). Sin embargo, en revisiones anteriores, ha estado ausente el reconocimiento de las particularidades y condiciones de la práctica investigativa en el campo educativo. Tales como la naturaleza de los fenómenos bajo estudio, corrientes y posturas teóricas, metodologías, así como los propósitos pedagógicos planteados en los programas de estudio para formar profesionales con orientación en esta área (Martínez-Rizo, 2019; Villa, 2005). Bajo esta perspectiva, el objetivo de esta investigación fue examinar los instrumentos de medición utilizados para evaluar la competencia investigativa de estudiantes universitarios en el campo educativo, centrándose en aspectos fundamentales en su diseño y elaboración, como son: uso propuesto, población objetivo, conceptualización del constructo, formato del instrumento y generación de evidencias de validez.

2. Metodología

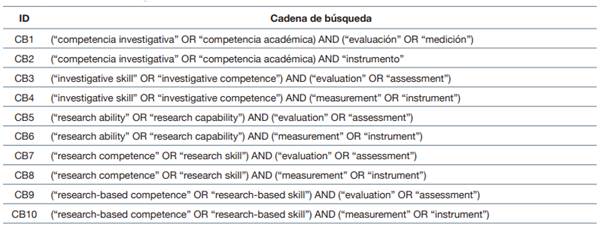

Esta investigación siguió los lineamientos establecidos por el protocolo PRISMA (Urrútia y Bonfill, 2010) para la conducción de revisiones sistemáticas de literatura, además se realizó un análisis crítico (Sandelowski y Barroso, 2007; Paterson, 2012) de la producción académica identificada. Este método, implicó una aproximación sistemática enfocada en la integración crítica e interpretativa de la literatura, más allá de una descripción de esta. Las bases de datos consultadas fueron Web of Science, Scopus y Scielo consideradas como los principales repositorios de artículos relacionados con el campo educativo en países anglosajones e iberoamericanos. Para la búsqueda de documentos se utilizaron 17 términos recuperados de revisiones previas de literatura sobre la competencia investigativa (e. g.Castillo-Martínez y Ramírez-Montoya, 2021; Valdiviezo-Villegas y Leyva-Aguilar, 2023), así como ejercicios similares realizados en otras áreas de conocimiento (e. g.Chen et al., 2021; Ianni et al., 2019). Estos términos, junto con operadores booleanos, se utilizaron para formular 10 cadenas de búsqueda (ver tabla 1). Todos los documentos identificados se exportaron al programa Mendeley para su almacenamiento y gestión.

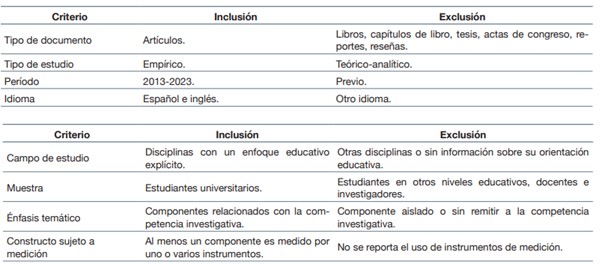

Los criterios de inclusión y exclusión se exponen en la tabla 2. Respecto al campo de estudio, se verificó que los artículos estuvieran relacionados con alguna disciplina dentro del campo de la educación (e. g. pedagogía, psicología educativa o docencia). Por otro lado, para el criterio muestra, se comprobó que la muestra reportada estuviera compuesta total o parcialmente por estudiantes universitarios inscritos en programas de licenciatura, maestría, especialidad o doctorado. En relación con el énfasis temático, se valoró si los componentes sujetos a medición estaban directamente relacionados con la competencia investigativa. Es decir, se excluyeron aquellos artículos donde el objeto de estudio (e. g. pensamiento profundo o creatividad) no estuviera vinculado explícitamente con la labor investigativa, incluso si dichos componentes forman parte de la competencia de interés. Por último, el criterio constructo sujeto a medición discriminó aquellas investigaciones en las que no se reportaba la aplicación de algún instrumento.

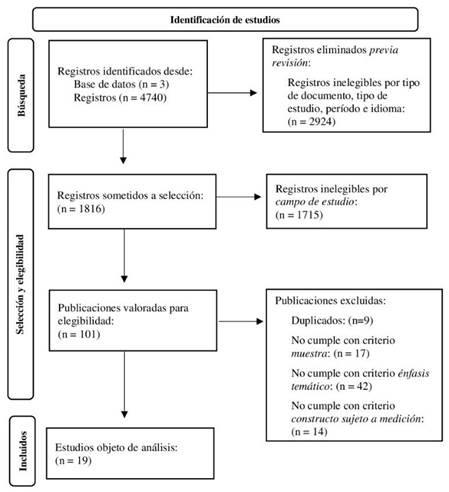

Las bases de datos arrojaron un resultado inicial de 4740 documentos. Una vez aplicados los criterios en torno al tipo de documento, estudio, período e idioma se redujo a 1816. Después, se revisaron títulos, resúmenes, palabras clave y se aplicaron los filtros disponibles en las bases de datos para verificar el criterio área de conocimiento. Esto condujo a una base preliminar de 101 estudios. Tras lo anterior, se hizo lectura de los apartados correspondientes al Método para identificar la muestra, Introducción para valorar el énfasis temático y, particularmente, las técnicas de recolección empleadas para verificar el criterio constructo sujeto a medición. A partir de esto, se consolidó una base de datos con 19 artículos (ver figura 1).

Nota. Adaptado de Urrútia y Bonfill (2010).

3. Resultados

Los resultados se organizan en función de los aspectos implicados en el diseño y elaboración de instrumentos de medición como son: uso propuesto, población objetivo, conceptualización del constructo, formato del instrumento y generación de evidencias de validez.

3.1 Uso propuesto

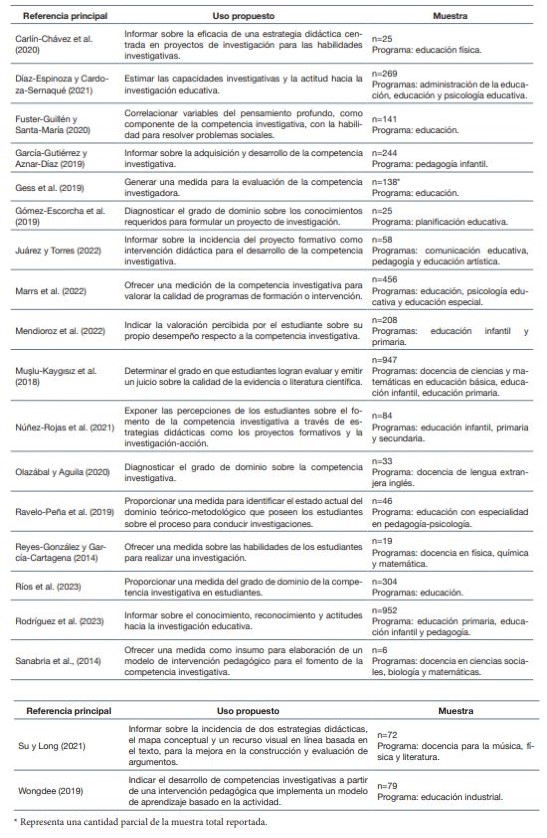

La construcción de instrumentos de medición ha sido impulsada por diversos motivos y finalidades. Principalmente, se han desarrollado como recursos para informar sobre el grado de adquisición y dominio de los conocimientos, habilidades y actitudes del estudiante en y para el ámbito de la investigación educativa (e. g.Díaz-Espinoza y CardozaSernaqué, 2021; Gess et al., 2019; Mendioroz et al., 2022; Muşlu-Kaygısız et al., 2018; Reyes-González y García-Cartagena, 2014; Ríos et al., 2023). Por otro lado, también se han construido para recopilar información destinada a evaluaciones de la efectividad o incidencia de programas o estrategias pedagógicas orientadas a fomentar la competencia investigativa (e. g.Carlín-Chávez et al., 2020; Marrs et al., 2022; Su y Long, 2021; Wongdee, 2019). En menor medida, estos han sido utilizados en evaluaciones diagnósticas que, en última instancia, han servido como punto de partida para el desarrollo de modelos o programas de intervención (e. g.Gómez-Escorcha et al., 2019; Olazábal y Aguila, 2020; Sanabria et al., 2014). El propósito previsto para un instrumento tiene repercusión en las posibles inferencias y conclusiones que se pueden extraer de sus puntajes. La descripción clara de sus finalidades permite una interpretación adecuada de la información obtenida, de lo contrario, existe el riesgo de distorsionar estas interpretaciones y arribar a conclusiones que los puntajes o resultados no pueden respaldar (Kane, 1992; 2013). En este sentido, la claridad y explicitación del uso propuesto son indicadores de calidad de un instrumento.

3.2 Población objetivo

La investigación educativa constituye un campo de conocimiento y ejercicio profesional interdisciplinario enriquecido por distintas perspectivas sobre los fenómenos educativos. Los hallazgos indican que las muestran están compuestas por estudiantes inscritos a una variedad de programas de estudios, diferenciados por sus objetivos curriculares y de formación. Por un lado, se encuentran aquellos que cursan programas orientados a la formación de profesionales en una disciplina específica, como: Pedagogía (e. g.Rodríguez et al., 2023), Pedagogía Infantil (e. g.García-Gutiérrez y Aznar-Díaz, 2019),

Psicología Educativa (e. g.Díaz-Espinoza y CardozaSernaqué, 2021; Marrs et al., 2022) o Comunicación Educativa (e. g. Juárez y Torres, 2022).

Por otro lado, destaca que una parte significativa de las poblaciones objetivo está conformada por estudiantes que se están formando como profesionales de la educación, es decir para la docencia en una disciplina o de contenidos escolares particulares. Principalmente, relacionados con la enseñanza a nivel primaria (e. g.Mendioroz et al., 2022; Núñez-Rojas et al., 2021), de las matemáticas para la educación básica (e. g.Reyes-González y García-Cartagena, 2014; Sanabria et al., 2014) y en la educación infantil

(e. g.Mendioroz et al., 2022; Muşlu-Kaygısız et al., 2018). Esta diversidad refleja un interés por obtener información sobre la adquisición y desarrollo de la competencia investigativa en estudiantes del campo educativo. Esto, a su vez, enfatiza la importancia de reconocer las particularidades tanto de la profesión como de los programas formativos según sus fines, convenciones disciplinarias, contexto sociocultural y condiciones institucionales (Hernández et al., 2019; Martínez-Rizo, 2019) que intervienen en la práctica de la investigación educativa. La tabla 3 sintetiza los hallazgos en relación con los usos propuestos y población objetivo expresada por las muestras reportadas.

3.3 Conceptualización del constructo

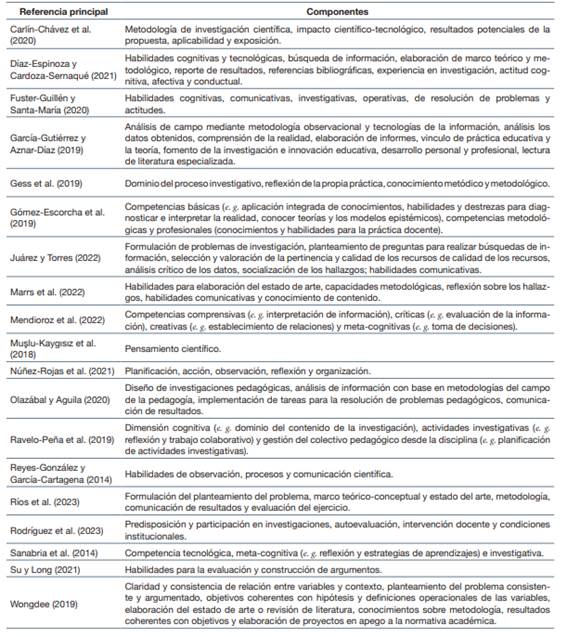

Existe una diversidad de enfoques en la conceptualización de la competencia investigativa debido a su naturaleza compleja. Esta pluralidad se refleja en los componentes de la competencia, donde un mismo aspecto puede ser definido de diferentes maneras. Por tanto, en este estudio se optó por apegarse, en la medida de lo posible, a las definiciones y principios organizadores establecidos por los autores de los estudios analizados (ver tabla 4). A pesar de esta decisión, el análisis reveló patrones que permitieron identificar componentes en los que convergen diferentes concepciones de la competencia investigativa. Principalmente, se destacan los siguientes:

Habilidades meta-cognitivas y cognitivas: incluyen el análisis de problemáticas, interpretación de los hallazgos, comprensión de conceptos y principios disciplinarios, pensamiento crítico, reflexivo y argumentativo (e. g. FusterGuillén y Santa-María, 2020; Marrs et al., 2022; Mendioroz et al., 2022; Muşlu-Kaygısız et al., 2018; Su y Long, 2021).

Conocimiento metodológico: se refiere al dominio de los etapas y procesos involucrados en el proceso investigativo y de la metodología en la investigación (e. g.García-Gutiérrez y Aznar-Díaz, 2019; Gess et al., 2019; GómezEscorcha et al., 2019; Núñez-Rojas et al., 2021; Olazábal y Aguila, 2020; Ravelo-Peña et al., 2019; Wongdee, 2019).

Comunicación verbal, escrita y digital: implica la capacidad de compartir, publicar y divulgar el conocimiento producto de la investigación en diferentes formatos como artículos, tesis o ponencias (e. g. Gómez-Escorcha et al., 2019; Juárez y Torres, 2022; Reyes-González

y García-Cartagena, 2014; Ríos et al., 2023; Sanabria et al., 2014).

Además, se identificaron otros componentes relacionados con:

Viabilidad u operatividad del proyecto de investigación: la capacidad del estudiante para planificar y ejecutar efectivamente un proyecto al margen de los recursos disponibles (CarlínChávez et al., 2020; Gess et al., 2019).

Componentes de carácter efectivo y actitudinales: relacionados con la disposición, deberes, percepciones y motivaciones del estudiante hacia la investigación (Díaz-Espinoza y CardozaSernaqué, 2021; Rodríguez et al., 2023).

Condiciones contextuales: el reconocimiento de las particularidades del entorno y condiciones institucionales como un aspecto fundamental en la elaboración y ejecución de proyectos de investigación (García-Gutiérrez y Aznar-Díaz, 2019).

Se observó también un componente distintivo para los estudiantes en programas para la formación de profesionales de la docencia, que se refiere a la aplicación en la práctica educativa de los resultados y avances generados mediante la investigación educativa (Gómez-Escorcha et al., 2019; García-Gutiérrez y Aznar-Díaz, 2019; Olazábal y Aguila, 2020). Es importante señalar que las definiciones de los componentes de la competencia investigativa, reportados en la literatura, suelen ser descriptivas y ambiguas. Esto dificulta identificar el vínculo entre la definición conceptual y los enunciados operacionales, que sirven como indicadores para ser puntuados o capturados por los instrumentos.

3.4 Formato del instrumento

La elección de un formato para el instrumento depende de cómo se ha definido el constructo en términos operacionales, lo cual a su vez determina el tipo de información recolectada. En otras palabras, las decisiones sobre qué tipo de instrumento diseñar y aplicar condicionan el alcance y la manera en que se captura el constructo sujeto a medición. Los resultados muestran una inclinación por el uso de cuestionarios para informar sobre la competencia investigativa de los estudiantes (e. g. Fuster y Santa-María, 2020; García-Gutiérrez y Aznar-Díaz, 2019; Gómez-Escorcha et al., 2019; Marrs et al., 2022; Mendioroz et al., 2022; Muşlu-Kaygısız et al., 2018; Núñez-Rojas et al., 2021; Reyes-González y García-Cartagena, 2014; Ríos et al., 2023; Rodríguez et al., 2023). Sin embargo, también se han utilizado formatos como la rúbrica de observación (Juárez y Torres, 2022), encuestas (Olazábal y Aguila, 2020; Ravelo-Peña et al., 2019), pruebas de conocimiento y escalas actitudinales (e. g.Wongdee, 2019). Además, se han usado instrumentos con diferente método de administración como las escalas de auto-evaluación (Díaz-Espinoza y Cardoza-Sernaqué, 2021; Gess et al., 2019). También, se han utilizado formatos que operan mediante el análisis de materiales como los protocolos para evaluar proyectos de investigación (Carlín-Chávez et al., 2020) y reportes verbales (Sanabria et al., 2014).

El predominio del cuestionario sigue una tradición en la medición educativa que considera los puntajes numéricos como indicadores principales de la adquisición, dominio y rendimiento relativos a una competencia (Ary et al., 2010; Linn, 2010). Ante este panorama, es importante promover el uso de múltiples instrumentos para obtener información sobre componentes de la competencia investigativa que podrían ser inaccesibles a través de los cuestionarios. Ejemplos de esto se encuentran en los estudios publicados por Fuster y Santa-María (2020) y Reyes-González y García-Cartagena (2014).

3.5 Generación de evidencias de validez

Las evidencias de validez son fundamentales para sustentar las posibles interpretaciones derivadas de los puntajes obtenidos mediante los instrumentos de medición. En los estudios analizados es común que estas evidencias se generen a través de análisis empíricos (AERA, APA y NCME, 2018), es decir por medio de pruebas estadísticas. Por ejemplo, el índice de alfa de Cronbach se reporta habitualmente con valores que oscilan entre 0.780 y 0.967 (DíazEspinoza y Cardoza-Sernaqué, 2021; Fuster y SantaMaría, 2020; García-Gutiérrez y Aznar-Díaz, 2019;

Marrs et al., 2022; Mendioroz et al., 2022; NúñezRojas et al., 2021; Ríos et al., 2023; Rodríguez et al., 2023) y la prueba de Kairse-Meyer-Olkin (KMO), utilizada principalmente para verificar la adecuación de los ítems al constructo sujeto a medición o estimar la pertinencia de conducir análisis factoriales, se reporta con valores en un rango de 0.701 a 0.973 (Muşlu et al., 2018; Núñez-Rojas et al., 2021; Ríos et al., 2023). En algunos estudios, se emplean índices de acuerdo entre expertos o jueces para brindar evidencias de validez de contenido con valores entre 0.80 y 0.950 (Su y Long, 2021; Wongdee, 2019).

Es importante destacar que en algunos casos no se reportan evidencias de validez (Carlín-Chávez et al., 2020; Gómez-Escorcha et al., 2019; Juárez y Torres, 2022; Olazábal y Aguila, 2020; Ravelo-Peña et al., 2019; Reyes-González y García-Cartagena, 2014; Sanabria et al., 2014) lo cual subraya la importancia de documentar adecuadamente las propiedades psicométricas de los instrumentos utilizados.

El análisis de este aspecto sugiere un enfoque tradicional sobre la validación centrada en la obtención de valores numéricos a través de índices, coeficientes y otras pruebas estadísticas como único argumento de que los puntajes obtenidos permiten realizar inferencias fundamentadas. Sin embargo, un caso distintivo es el trabajo de Gess et al. (2019) donde se conduce un proceso de validación desde un enfoque argumentativo. En este caso, los autores plantean suposiciones como: 1) la escala refleja la competencia investigativa en ciencias sociales distinguiéndose esta de las ciencias naturales, 2) los puntajes dan cuenta del desempeño del estudiante, o 3) la escala es aplicable a estudiantes de varias disciplinas dentro de las ciencias sociales (e. g. ciencias educativas o sociología). A partir ello, realizan análisis empíricos y lógicos para generar evidencias de validez que respalden estas suposiciones y, por tanto, el uso de los resultados del instrumento.

4. Discusión y conclusiones

Las investigaciones desde la Evaluación Educativa han resaltado la complejidad inherente a la determinación de cómo obtener medidas o valores que reflejen de manera precisa la adquisición, rendimiento y desempeño de las competencias adquiridas por estudiantes universitarios. Por tanto, la elaboración de instrumentos de medición requiere tanto de una cuidadosa planeación como de procedimientos sistemáticos si se pretende utilizar sus resultados de manera efectiva en la toma de decisiones. El objetivo del estudio consintió en examinar los instrumentos utilizados para informar sobre la competencia investigativa en el ámbito educativo de estudiantes universitarios. El análisis se centró en los principales aspectos implicados en su diseño y desarrollo, tales como: uso propuesto, población objetivo, conceptualización del constructo, formato del instrumento y generación de evidencias de validez.

Durante la última década (2013-2023), la elaboración de instrumentos se ha centrado principalmente en los siguientes objetivos: 1) informar sobre el grado en que los estudiantes han adquirido y desarrollado los diversos componentes que integran la competencia investigativa; 2) brindar información con base en cuál evaluar la efectividad de intervenciones pedagógicas destinadas a promover dicha competencia; y 3) proporcionar datos para evaluaciones diagnósticas. El uso previsto de un instrumento de medición no se limita simplemente a enunciar sus propósitos y finalidades, su definición clara y explícita delimita las inferencias, conclusiones y decisiones que sus resultados pueden respaldar, vinculándose de manera directa con la generación de evidencias de validez (Hattie y Leeson, 2013; Kane, 1992; 2013).

Dada las particularidades de la investigación educativa en términos de sus perspectivas teóricas, recursos metodológicos y convenciones académicas, la evaluación de la competencia investigativa en esta área requiere instrumentos sensibles a estas distinciones. Durante el proceso de selección en la revisión sistemática se observó una reducción importante de artículos que cumplieran con el criterio de campo de estudio, dirigido a identificar aquellas investigaciones que remitieran de manera explícita a disciplinas con un enfoque educativo. Esto coincide con los hallazgos presentados por Sandoval-Henríquez y SáezDelgado (2023) donde se destaca que la producción académica sobre el tema de interés se concentra en las ciencias de la salud (e. g. medicina y enfermería) y naturales (e. g. física, biología y química).

Por otro lado, es importante distinguir entre la formación de profesionales en una disciplina con enfoque educativo (e. g. psicología educativa o pedagogía) y la formación de profesionales para la educación o formación inicial docente. En tanto que cada una está enmarcada en proyectos formativos con objetivo curriculares y demandas tanto profesionales como sociales diferentes (Martínez-Rizo, 2019; Villa, 2005). En este sentido, la selección de los estudiantes que conformen la población objetivo debe realizarse cuidosamente con el fin de desarrollar instrumentos sensibles a estas distinciones y proporcionar información coherente sobre el logro de la competencia investigativa.

Al tratarse esta competencia de un constructo complejo y multifactorial su definición representa un desafío para la Evaluación Educativa. A pesar de ello, los hallazgos resaltan cierta uniformidad estructural en la conceptualización del constructo, es decir de la competencia investigativa en y para el ámbito educativo. Las componentes e indicadores siguen una organización común de acuerdo con dimensiones meta-cognitivas, cognitivas, metodológicas, así como en aspectos relacionados con la comunicación, viabilidad y operatividad, atributos afectivo-actitudinales y condiciones contextuales donde se practica la investigación. Estas dimensiones o categorías están en consonancia con las establecidas en la literatura especializada (Ciras-Calí et al., 2022; Colás-Bravo y Hernández, 2021; Espinoza et al., 2016; Martínez-Rizo, 2019; Sandoval-Henríquez y Sáez-Delgado, 2023).

Por otro lado, es importante señalar que en la mayoría de los estudios analizados las definiciones suelen presentarse desde un nivel descriptivo y con frecuencia las definiciones operacionales de cada componente sujeto a medición están ausentes. Esta falta de claridad limita la discusión sobre el sentido otorgado a la competencia investigativa y cómo medir sus diferentes componentes, así como dificulta el trabajo colaborativo, acumulativo y consistente entre la comunidad académica.

La diversidad de definiciones sobre la competencia investigativa conlleva a una variedad de posibles formatos para los instrumentos de medición. Aunque el cuestionario es el formato comúnmente utilizado, también se identificaron otros como la rúbrica de observación, pruebas, escalas actitudinales y de auto-evaluación, protocolos de evaluación de proyectos de tesis o reportes verbales. En la selección de uno u otro formato, se deben considerar sus alcances y limitaciones al informar sobre un componente específico de la competencia investigativa. Es decir, es necesario valorar la pertinencia del formato de acuerdo con los usos propuestos y el tipo de información que cada uno ofrece (Ary et al., 2010; AERA, APA y NCME, 2018; Naglieri, 2013). Además, cabe impulsar el uso de múltiples formatos para capturar de manera más completa una competencia compleja como la investigativa (Fuster y Santa-María, 2020; Reyes-González y García-Cartagena, 2014).

Por último, los procedimientos para generar evidencias de validez se han realizado desde una aproximación tradicional. La noción de validez en los estudios analizados remite principalmente a una propiedad del instrumento que se comprueba mediante la obtención de un valor numérico a través de herramientas estadísticas. Estos valores se consideran como único argumento para respaldar los resultados del instrumento. Sin embargo, destaca el estudio realizado por Gess et al. (2019) quienes llevaron a cabo la validación desde un enfoque argumentativo.

Ante este panorama, se sugiere generar evidencias de validez a partir de la aproximación argumentativa. Esto implica hacer uso de diversas fuentes de información y estrategias de análisis para obtener evidencias consistentes y coherentes que fundamenten tanto los componentes de la competencia investigativa sujetos a medición como los posibles usos e interpretaciones de los resultados arrojados por el instrumento (AERA, APA y NCME, 2018; Kane, 2013; Ramos, 2015).

Este estudio destaca la necesidad de realizar análisis más profundos sobre las definiciones tanto conceptuales como operacionales de la competencia investigativa, así como de sus rasgos distintivos en la formación de profesionales en disciplinas con orientación educativa y en la formación para profesionales de la docencia. Asimismo, se subraya la importancia de examinar los procedimientos para obtener evidencias de validez de manera más exhaustiva.