Introducción

La inteligencia artificial (IA) es una tecnología que reporta importantes beneficios, aunque constituye un detonante de numerosas problemáticas y controversias, por ejemplo, en materia de sesgos algorítmicos (Angwin et al., 2016; Eubanks, 2018), opacidad de los sistemas (Larsson y Heintz, 2020), sostenibilidad (Crawford, 2023), etc. Esta ambivalencia ha motivado a la Comisión Europea y al Gobierno de España para promover una IA confiable, fundamentada en una perspectiva humanocéntrica, a través de una serie de iniciativas. Si bien estas propuestas son una respuesta meritoria, carecen de una estrategia educativa específica que pueda contribuir al desarrollo de una IA alineada con los deseos y necesidades de la ciudadanía. Así pues, el objetivo principal de este trabajo es explicar el valor que la ética aplicada puede transmitir a los estudios técnicos, especialmente a la ingeniería, en lo tocante al fortalecimiento profesional, la gobernanza ética y una investigación e innovación responsables.

La metodología utilizada para alcanzar dicho objetivo consiste, mayormente, en el análisis bibliográfico de iniciativas europeas y españolas centradas en un ecosistema confiable de IA, de diversas experiencias que han favorecido el desarrollo moral de los educandos y el cultivo de responsabilidad profesional, así como de un conjunto de referentes esenciales de la ética cívica. Además, se ha llevado a cabo una exploración cuantitativa de los currículos académicos de ingeniería relacionados con la IA en el contexto de las universidades públicas españolas.

En cuanto a la estructura, el presente trabajo está distribuido en cuatro partes. En primer lugar, se detallan algunos elementos que contribuyen a la visión europea para la IA confiable; en segundo lugar, se presenta una serie de actividades que insisten en la importancia de la enseñanza de la ética; en la tercera parte es posible apreciar una relación de asignaturas vinculadas a la ética y a la ingeniería; por último, se propone un marco fundamentado en la ética cívica para proyectar una perspectiva procedimental, hermenéutica, dialógica y crítica en la profesión de la ingeniería, a través de la educación, subrayando el carácter social de las profesiones en las sociedades plurales (Conill y Arenas Dolz, 2010).

El interés institucional en una IA confiable

Durante la última década, la Comisión Europea y el Gobierno de España han presentado varias iniciativas que expresan su interés y voluntad para procurar un desarrollo ético de la IA, especialmente, a través de la conceptualización de una IA confiable. En el primer caso, esta inclinación se ha expresado con mayor notoriedad, como certifican los documentos Ethics Guidelines for Trustworthy AI y White Paper On Artificial Intelligence: a European approach to excellence and trust. En lo que respecta a España, las diversas resoluciones sobre IA presentadas señalan en numerosas ocasiones la necesidad de asegurar un futuro ético para esta tecnología. Sin embargo, en el conjunto de directrices propuestas para promover la ética no son detallados mecanismos educativos específicos, como se argumentará más adelante.

Antes de analizar algunos elementos de las iniciativas de la Comisión Europea y el Gobierno de España, es preciso llevar a cabo una aproximación a la IA confiable. Han transcurrido casi siete décadas desde la celebración del Dartmouth Summer Research Project on Artificial Intelligence, un acontecimiento que simboliza la génesis de los intelectos sintéticos (McCorduck, 1991, pp. 95-96). Con el transcurso de los años, es cada vez más evidente que los sistemas artificiales no solo suministran importantes beneficios, sino que también acarrean preocupantes desafíos éticos, legales, sociales, ambientales, etc. (Floridi, 2021). Como respuesta a estos desafíos han venido formulándose una gran cantidad de llamados para una IA beneficiosa (Future of Life Institute, 2017), una IA responsable (Dignum, 2019; Université de Montréal, 2017), una IA para el bien común (AI4SG) (Monasterio Astobiza, 2021), una IA ética (Floridi et al., 2018), entre otros.

Al margen del complemento empleado para la IA, todas estas manifestaciones enfatizan esencialmente los mismos objetivos, es decir, la necesidad de maximizar los beneficios y mitigar o prevenir los riesgos y los peligros. En el seno de la Comisión Europea, el Grupo Independiente de Expertos de Alto Nivel sobre Inteligencia Artificial elaboró el documento Ethics Guidelines for Trustworthy AI (Comisión Europea, 2018) para fundamentar una IA confiable a través de la propuesta de un conjunto de orientaciones éticas de corte principialista. El concepto de IA confiable presentado inicialmente asume que la confianza es un elemento imprescindible para la constitución y el fortalecimiento de la sociedad europea. Sin embargo, la conceptualización de la confianza y las estrategias que deben plantearse para promoverla representan tareas muy complejas que son discutidas en la actualidad.

Más tarde, en 2020, la Comisión Europea presentó White Paper On Artificial Intelligence: a European approach to excellence, otra iniciativa que expresa la intención de convertir la comunidad política europea en líder mundial de la innovación en IA. Los pilares elementales del White Paper son: por un lado, un marco político para el establecimiento de un entorno de excelencia a través de una investigación e innovación impulsada a partir de la colaboración entre el sector público y privado; por otro lado, un entorno de confianza como un elemento indispensable para un futuro normativo y respetuoso con el proyecto político de la UE y un desarrollo humanocéntrico de la IA.

En cuanto al contexto español, pueden apreciarse tres resoluciones fundamentales. En primer lugar, la Estrategia Nacional de Inteligencia Artificial (Gobierno de España, 2020a), la apuesta más importante para impulsar el desarrollo de la IA como un motor de cambio y fortalecimiento de las instituciones. El Gobierno de España ha expresado el deseo de integrar la ética en la investigación e innovación de la IA, con la finalidad de procurar un equilibrio entre las oportunidades técnicas y el bienestar social mediante un conjunto de acciones, como el diseño de GobTechLab, la evaluación ética y legal de sistema automatizados, la creación de foros ciudadanos como Digital Future Society, la elaboración de una “Carta de derechos digitales”, entre otras actividades.

En segundo lugar, el Plan España Digital 2025 (Gobierno de España, 2020b) proyecta la transformación digital programada en los próximos años. Tiene como principales objetivos servir de impulso al crecimiento económico, la reducción de las desigualdades, la mejora e incremento de la productividad y el aprovechamiento de las potencialidades de las nuevas tecnologías. Este plan está formado por un conjunto de diez ejes estratégicos, entre los que se encuentra “Economía del dato e inteligencia artificial”. Por último, en el Plan de Recuperación, Transformación y Resiliencia (Gobierno de España, 2021) también es posible apreciar una referencia a la IA en el componente nro. 16 de la 6ª palanca, denominada “Pacto por la ciencia y la innovación: refuerzo a las capacidades del Sistema Nacional de Salud”. Este componente es articulado a través de la Estrategia Nacional de Inteligencia Artificial, mencionada anteriormente.

Las iniciativas señaladas son una forma meritoria para promover la confianza, sin embargo, se encuentran limitadas por el acelerado avance de la tecnología y el riesgo de obsolescencia de los marcos de regulación y autorregulación. En virtud de estas consideraciones, es indispensable hacer hincapié en el valor de la enseñanza de la ética aplicada como una respuesta a los desafíos de la IA. Los retos de esta tecnología constituyen un llamado para abordar preguntas centrales sobre el papel de los afectados por los intelectos sintéticos, los principios que guían su desarrollo, los mecanismos que facilitan la generación de confianza, los criterios que deben ser considerados para la evaluación de los impactos, cómo hacer partícipe a la sociedad de los cambios, etc. (González Esteban y Calvo, 2022, p. 4). Para estos propósitos es esencial incentivar la adaptación de la investigación y la innovación a las necesidades de la ciudadanía. Por ello es deseable fundamentar la educación del profesional en un marco procedimental, hermenéutico, dialógico y crítico como el que ofrece la tradición ético cívica. La falta de una estrategia educativa específica en materia de ética aplicada dificulta el cultivo de la reflexividad moral para una gestión justa y responsable en el seno de las sociedades pluralistas. Así pues, es preciso solicitar un mayor protagonismo de la ética aplicada, en particular, en el contexto español, con la finalidad de allanar el camino a la generación de un entorno confiable y cultivar un ethos cordial, dialógico, inclusivo y crítico en los profesionales de la ingeniería que se encuentran inmersos en el universo de los intelectos sintéticos.

El valor educativo de la ética para la ingeniería

A medida que la innovación tecnológica evoluciona a un ritmo cada vez más acelerado, la capacidad y la oportunidad para reflexionar sobre los aspectos éticos implicados en la ingeniería se ha convertido en una razonable exigencia (Bengoetxea y Mitcham, 2010). Es fundamental que los profesionales puedan identificar las cuestiones éticas en su lugar de trabajo, puesto que la IA representa un conglomerado de ideologías, prácticas, materiales, flujos energéticos, instituciones, etc., que conforman una compleja unidad sociotécnica. El aceleracionismo económico ha impuesto un ritmo de trabajo que exige la disponibilidad de resultados en un breve periodo de tiempo, dificultando la reflexividad ética. Adicionalmente, la ideología del solucionismo tecnológico ha impregnado el motor de la investigación y la innovación, debilitando el juicio crítico (Morozov, 2015). En consecuencia, esta situación exige el impulso de la enseñanza de la ética como una actividad vital que impacta en la sensibilidad y estimula una mejora significativa de las habilidades de razonamiento moral (Clarkeburn et al., 2002). La necesidad de llevar a cabo decisiones éticas ha incrementado su importancia en el entorno de todas las profesiones, especialmente en la ingeniería, a tenor de su impacto social.

En atención a esta necesidad, hay algunas propuestas encaminadas a la estimación de la enseñanza de la ética. Accreditation Board for Engineering and Technology (ABET) impulsó, en 1998, un conjunto de criterios recogidos en el documento Engineering Criteria 2000 (EC2000), para incentivar el compromiso ético en los programas educativos estadounidenses de ingeniería (Volkwein et al., 2004). Unos años más tarde, en 2004, la UNESCO presentó el Programa de Educación Ética, centrado en el suministro de información a los responsables de políticas públicas, personal docente e investigador a través del intercambio de experiencias, formación en habilidades didácticas para fomentar la enseñanza de la ética y la elaboración de una propuesta de currículo básico para el área de bioética, en sintonía con la Declaración universal sobre bioética y derechos humanos (UNESCO, 2006). El éxito de este programa en el área de la bioética invita a emprender un esfuerzo similar en otras áreas, especialmente en la ética aplicada a la IA. Finalmente, otra experiencia que ilustra la importancia de la estimación de la ética en el entorno profesional y que merece especial atención es Ethos Living Lab (ELL), un proyecto ejecutado a finales de 2018 por docentes e investigadores del área de filosofía moral, política y social de la Facultad de Filosofía y Ciencias de la Educación de la Universitat de Valencia. El ELL vincula a la comunidad universitaria con los colegios profesionales valencianos, con el interés de promover y fortalecer habilidades éticas, incentivar el compromiso e incrementar la sensibilidad moral, tanto de los profesionales como del colectivo académico (Terrones Rodríguez, 2023). En definitiva, estas iniciativas señalan la pertinencia de la estimación de la ética y una oportunidad para identificar la relevancia moral de los temas más destacados, entre los que, sin duda, se encuentra la IA.

Las experiencias anteriormente señaladas sugieren que la búsqueda de un lugar para la ética en el contexto educativo destaca por su dificultad. En cualquier caso, es pertinente remarcar lo sustancial de la educación, en términos morales, respecto a la instrucción. Mientras que la primera introduce factores éticos que configuran el ethos y la personalidad, la segunda se encarga de la transferencia de conocimientos técnicos y aspira a intereses epistemológicos distintos (Gracia Calandín, 2018, p. 76). Esta consideración conlleva el reconocimiento de la peculiaridad de la enseñanza de la ética (Ortiz, 2008), en vista de que no es una rama filosófica especialmente vinculada a conocimientos y habilidades técnicas, sino a la actitud y al carácter, como señala Diego Gracia (2016, p. 7). Efectuada esta aclaración, es adecuado subrayar que la finalidad principal de la defensa de la ética en la acción educativa responde al desarrollo moral a través de instrumentos intelectuales, como la reflexión, y competencias de interacción, como el diálogo o la deliberación (Terrones Rodríguez, 2017). De este modo, una educación que valora lo suficiente la ética, reconoce el papel del juicio crítico, la influencia de la sensibilidad moral y el compromiso social (Lönngren, 2020). Ahora bien, es oportuno indicar la falta de un consenso en lo tocante a la definición de la ética y su enseñanza en el contexto de la ingeniería (Hess y Fore, 2018). Sin embargo, Joseph R. Herkert (2001, 2005) establece una distinción entre microética y macroética que constituye un referente esencial para este trabajo. El eticista norteamericano afirma que la microética se ocupa de cuestiones éticas que los ingenieros afrontan desde un plano individual; mientras que la macroética está orientada a la reflexión de los impactos sociales del desarrollo tecnológico y la responsabilidad de los profesionales. Pese a que la perspectiva microética es fundamental para el desempeño profesional, dada la complejidad sociotécnica de la IA, se entiende que es necesario invertir mayores esfuerzos educativos en el terreno macroético.

Los profesionales de la IA se enfrentan continuamente a la dificultad de tomar decisiones que demandan una competencia ética que implica mucho más que la simple comprensión de teorías. Ann Gallagher (2006) define esta competencia como la posesión de conocimientos éticos junto a la capacidad de apreciar la relevancia moral de una situación (percepción ética); reflexionar de manera crítica sobre lo que los profesionales saben, son y hacen (reflexión ética); destacar la importancia de la práctica ética (comportamiento ético); y ser ético. Aunque Gallagher reúne estas cinco habilidades éticas con la intención de mejorar la educación en el campo de la enfermería, es posible trasladar su propuesta al ámbito de la ingeniería (Barry y Ohland, 2013). El ámbito de los cuidados ofrece numerosos ejemplos para insistir en las consecuencias sustanciales de la integración de la ética en los planes de formación (Byrne et al., 2015).

Del mismo modo, la comprensión de la trascendencia de la responsabilidad se erige como un elemento fundamental. Su importancia se origina en la globalización como un estimulante para la generación de preguntas acerca de los estándares de excelencia existentes y las concepciones actuales de los bienes internos de la ingeniería. El trabajo desarrollado por Alejandra Boni y sus colegas (2019) en la Universitat Politècnica de València pone de manifiesto el alcance del establecimiento de vínculos prácticos con los contextos reales para estimular el florecimiento de la responsabilidad profesional.

La significación de la responsabilidad profesional y el deterioro del carácter ocasionado por la maquinaria capitalista (Sennet, 2000), precisan una mayor implicación de las universidades en la educación ética. Agustín Domingo Moratalla (2010, pp. 104-106) sostiene que las universidades preocupadas por la ética profesional deben ofrecer tres modelos de responsabilidad: en primer lugar, una responsabilidad encaminada a la profesionalización mecanicista mediante un compromiso económico pragmático; en segundo lugar, la universidad tiene que implicarse en la modernización cívica por medio de la profesionalidad civilizadora, pues es conveniente entender la responsabilidad profesional como corresponsabilidad pública; finalmente, el cultivo de la responsabilidad también puede ser expresado en la profesionalización identificante, es decir, aquella implicada en la religación personal, la coimplicación y el compromiso.

La ingeniería se encuentra estrechamente ligada a la IA, que ha adquirido su notoriedad en la Cuarta Revolución Industrial (Chen y Shen, 2019). A medida que están surgiendo cambios sustanciales en las esferas políticas, económicas y culturales, en cuanto subsistemas que integran la realidad social, como resultado de la evolución de los sistemas artificiales, es necesario hacer hincapié en la responsabilidad de la ingeniería. En todo caso, con el interés de clarificar la tarea reflexiva de este trabajo, es apropiado dirigir la atención hacia aquellas ingenierías vinculadas a la investigación e innovación de la IA, entre las que pueden encontrarse especialidades como la informática, la computación, el software, la robótica, la ciencia de datos, entre otras. Estas ingenierías ofrecen un servicio indispensable a la sociedad y contribuyen al fortalecimiento de los sistemas económicos y sociales.

La peculiaridad de la ingeniería y el compromiso social que se espera de ella, constituyen dos elementos fundamentales que motivan el reconocimiento del valor sustancial de la ética y su enseñanza. Resaltar este valor significa apostar por la responsabilidad social de las universidades, haciendo hincapié en su vocación mediadora en la promoción de valores tan importantes como la justicia o la solidaridad (Domingo Moratalla 2005). En este marco, la integración de la ética aplicada en los estudios universitarios ingenieriles relacionados con la IA puede contribuir: primero, vinculando la racionalidad estratégica con la racionalidad discursiva, considerando, no solo la racionalidad sujeto-objeto, sino la racionalidad sujeto-sujeto, donde existe una importante aportación axiológica; segundo, fomentando la simetría entre los grupos de interés afectados por las decisiones colectivas, con la finalidad de legitimar los procesos de decisión; finalmente, insistiendo en una comprensión crítica de los fines (Lozano Aguilar, 2010, pp. 271-272).

La ética y su enseñanza en la educación superior española

La estrategia más extendida en las universidades públicas españolas que ofertan estudios de grado y máster de ingeniería comprometidos con el conocimiento de la IA e intentan integrar una perspectiva ética, consiste en la adopción de un enfoque deontológico. Este enfoque ha impregnado algunas instituciones y organizaciones, fomentando la autorregulación y el cumplimiento de códigos normativos. Aunque la deontología mejora el desarrollo profesional, es oportuno estimular la reflexividad moral, en términos macroéticos, especialmente en cuestiones relacionadas con la igualdad de oportunidades, la transparencia, la explicabilidad, la brecha digital, la sostenibilidad, etc. Por consiguiente, es primordial reclamar un incremento de la enseñanza de la ética, con el propósito de que esta no quede reducida a un elemento optativo y decorativo de la formación (Gracia, 2016, p. 170).

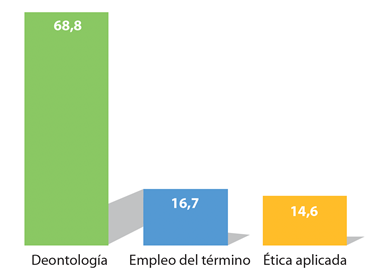

La revisión de los programas académicos de ingeniería vinculados al estudio de la IA arroja un conocimiento aproximado sobre las tendencias que despiertan un mayor interés. En el contexto de las universidades españolas de titularidad pública predomina una inclinación generalizada hacia la perspectiva técnico-profesional. De un total de cincuenta universidades, 19 ofrecen asignaturas en los estudios de grado y máster que sugieren una reflexión ética en su título. Sin embargo, una vez analizados los programas, en su gran mayoría, es decir, 30 de un total de 44, abordan la ética desde un punto de vista deontológico; seguidas de siete asignaturas en las que se emplea el término “ética” para referir su denominación, pese a que en su desarrollo no son abordadas cuestiones propias de la filosofía moral; en última instancia, un número reducido de siete asignaturas que profundizan las problemáticas y desafíos sociales de la IA, y que podrían ubicarse en la estela de la ética aplicada.

Tabla 1 Relación de asignaturas que sugieren una reflexión ética en su título

Fuente: planes de estudio y programas de las asignaturas de las universidades públicas españolas.

La siguiente figura indica los valores porcentuales de la distribución de estas asignaturas:

Como revela este gráfico, existe una inclinación mayoritaria hacia la integración de elementos deontológicos para responder a los desafíos de la IA. Joakim Sandberg (2013) define la deontología como un enfoque ético encargado de juzgar la moralidad de las acciones en función de su adhesión a una serie de principios o reglas, que suelen dividir las acciones morales según tres categorías: obligatorias, prohibidas y permisibles. El valor principal de la deontología reside en su aplicación al entorno de las profesiones, designando la ética particular de una determinada profesión (Ten Have y Patrão Neves, 2021).

En la senda de la deontología es conveniente subrayar la presencia de unos instrumentos y procedimientos de autorregulación de la práctica profesional denominados “códigos deontológicos” (CD), formados por un conjunto de pautas expresadas en documentos con carácter normativo (Bilbao et al., 2006). Estos códigos tienen como finalidad ofrecer orientación a los profesionales que, en el desempeño de su trabajo, encuentran problemas con relevancia moral y brindar una descripción de aquellos valores y principios que resultan deseables. En el ámbito de la ingeniería, Michael Davis (1998, p. 43) afirma que los objetivos principales de estos códigos son: guiar al profesional y ayudar a evitar el mal comportamiento; servir como un referente para que otros agentes juzguen su comportamiento, favoreciendo la reputación de la profesión en su conjunto; y contribuir en la definición de la imagen que un profesional tiene de sí mismo. En conclusión, es posible afirmar que el enfoque deontológico se ubica principalmente en una perspectiva técnico-profesional.

Debido a la complejidad de los desafíos actuales de la IA y la agudización de determinadas problemáticas, aunque son necesarias y suponen un elemento útil para satisfacer la operatividad de la responsabilidad, las iniciativas de autorregulación deontológica resultan insuficientes para configurar alternativas de desarrollo que radiquen su fundamento en dinámicas de reflexividad moral e inculturación ética sensibilizada con valores cívicos (Davis, 2020).

En primer lugar, como apunta Adela Cortina (1996), la ética aplicada, en virtud de su naturaleza hermenéutica crítica, señala como objetivo esencial el descubrimiento de aquellos aspectos morales comprometidos en las actividades humanas. Asimismo, reflexiona sobre la adecuación de los medios para el acercamiento al bien interno, en sintonía con la moral cívica compartida en el seno de una sociedad pluralista. Y pone en valor la colaboración entre los diversos afectados por la realización de las actividades.

En segundo lugar, la falta de interés en la profundización de la reflexividad moral, constituye otro de los motivos para señalar los límites de la deontología. El mero cumplimiento mecánico de los códigos no implica el cuestionamiento normativo ni motiva una perspectiva hermenéutica crítica de las actividades humanas (Domingo Moratalla, 2018, p. 77). Además, el estricto cumplimiento de las normas que induce la deontología es insuficiente, ante todo, porque las regulaciones indican la legalidad o ilegalidad de las acciones, pero no motiva el cuestionamiento sobre las buenas y las mejores acciones, es decir, sobre qué fundamentos son los que hacen posible que una sociedad sea mejor. En consecuencia, la estrategia adoptada por las universidades públicas españolas para promover la ética en el entorno de la IA resulta insuficiente por las limitaciones del procedimiento deontológico y por la complejidad de este sistema sociotécnico y la ambivalencia de sus resultados. Por lo tanto, es preciso, impulsar mecanismos de innovación educativa para promover una inculturación ética sostenida en un marco procedimental, hermenéutico, dialógico y crítico como el que ofrece la tradición discursiva.

A pesar de la particularidad de su investigación, que no ha tenido por objeto el caso español, el trabajo llevado a cabo por Byron Newberry (2004) contribuye a la identificación de las posibles causas que motivan la falta del reconocimiento del valor de la ética en el espacio académico ingenieril. La aparente superficialidad característica de las asignaturas dificulta el compromiso emocional con la ética. El ambiente, esencialmente técnico, no favorece el encuentro dialógico con otros saberes, disminuyendo la reflexión moral. Asimismo, la rigidez de los planes de estudio para integrar la ética induce en el estudiantado una visión dogmática sobre la técnica y la subestimación de otros saberes, mayormente, humanísticos.

Para ofrecer soluciones a los numerosos desafíos de la IA y sus múltiples naturalezas, deben ser abordados problemas centrales que condicionan su desarrollo mediante la formulación de preguntas sobre el papel de los afectados por esta tecnología, qué mecanismos emprender para promover la transparencia y la explicabilidad, qué principios deben orientar su diseño e implementación, qué criterios hay que incorporar para la evaluación de los impactos, cómo facilitar la generación de confianza, cómo incluir a la sociedad para hacerla partícipe de estos cambios, etc. Este tipo de preguntas estimulan la conciencia cívica que puede enriquecer el estudio de la ingeniería y, por ende, la práctica profesional a través de un fortalecimiento de la reflexividad moral, al integrar elementos sapienciales alternativos al dogma técnico. La deriva que ha adoptado la investigación en el campo de la IA, reduciendo la comprensión de los sistemas a aspectos estrictamente técnicos, ocasiona una brecha epistemológica que dificulta los análisis sobre las implicaciones morales y políticas de los sistemas artificiales (Dahlin, 2021). Por tanto, es primordial llevar a cabo un encuentro con la tradición ético-cívica, con el propósito de fortalecer y complementar la autorregulación y, al mismo tiempo, desarrollar dinámicas educativas que sienten las bases de una gobernanza ética de la IA, sustentada en procesos más participativos y deliberativos, en aras de una gestión justa y responsable que reconozca a los afectados en el contexto de las sociedades tecnologizadas.

La ética cívica como marco normativo para la educación

La tradición discursiva iniciada por Karl Otto Apel (1985a, 1985b) y Jürgen Habermas (1989, 2000) en el decenio de 1980, y posteriormente ampliada por Adela Cortina (1986, 1990, 2007, 2010), Jesús Conill (2006) y Domingo García Marzá (1992, 1997, 2004), establece que el proceso de fundamentación moral de las normas debe resultar del discurso participativo de todos los afectados por estas normas. Esta consideración se consolida en la tradición discursiva como una idea regulativa o proceso trascendental de fundamentación que contiene dos implicaciones esenciales: en primer lugar, que todos los afectados por las normas tienen que ser considerados interlocutores válidos e incluidos en el diálogo, y en segundo lugar, que deben ser establecidas las condiciones ideales para un verdadero diálogo racional.

La propuesta ético-discursiva es desplegada en un horizonte moral donde el propósito del discurso consiste en la búsqueda de necesidades comunes a todos los afectados por un conflicto de intereses. Según esta apreciación, es posible establecer intereses comunes para que todos los afectados puedan ver reconocidas sus consideraciones subjetivas. En este sentido, la corrección o justicia de una norma depende de la posibilidad de encontrar un acuerdo general entre los afectados (García Marzá, 1992, pp. 60-61). Esta valoración discursiva establece un hilo conductor entre las cuestiones morales y las cuestiones éticas, pues los intereses subjetivos afectan, en mayor o menor medida, al resto de involucrados en las normas, al considerar que la vida es un espacio común que reclama un ejercicio de reflexividad moral más amplio, con aspiración a la validez universal de las normas o a su legitimidad (Habermas, 2000, pp. 114-115). Por lo tanto, el factum de la razón discursiva exige a los participantes del discurso que asuman, previamente, la posibilidad de llegar a un consenso racional que exprese el interés común de todos los afectados como una máxima de validez universal.

El enfoque discursivo ha motivado una serie de críticas que giran en torno a una supuesta idealización y abstracción. Por un lado, Horst Steinmann y Albert Löhr (1994), recurriendo a un postulado filosófico de Paul Lorenzen (1987), plantearon que el comienzo del diálogo es la experiencia del conflicto y una aspiración universal a la paz, y según esta consideración, el fundamento trascendental de la comunicación propuesto por la tradición ético-discursiva puede resultar idealista. Por otro lado, Steinmann y Löhr (1994) insisten en la imposibilidad de celebrar un diálogo racional entre todos los afectados en condiciones de simetría. Una crítica adicional es formulada por Cortina y va dirigida a la excesiva abstracción del planteamiento procedimental de Apel (1985a, 1985b) y Habermas (1989, 2000), y a una postura de la razón demasiado centrada en la lógica. La posición de la filósofa española responde a la necesidad de atender a la dimensión emocional y la influencia del contexto histórico, dos elementos, según ella, que no han sido lo suficientemente abordados por los alemanes. De este modo, Cortina (1986, 1990, 2007, 2010) intenta superar las críticas a la tradición discursiva a través de la presentación de un programa de ética cívica que recoge el testigo de algunos elementos de la hermenéutica. Su programa aglutina un momento deontológico para la fundamentación de las normas, el cultivo de sentido del télos de la praxis humana, la valoración de la complejidad fáctica del mundo real y la responsabilidad con miras al futuro (Cortina, 1986, 1990, 1994, 2001, 2007, 2010). La ética cívica propuesta por la autora responde a la complejidad de una sociedad pluralista, donde existen dos niveles: el primero, formado por diversas prescripciones valorativas que entienden la moral como un elemento esencial para el diseño de una forma de vida felicitante (ética de máximos), el segundo nivel, referido a una moral cívica compartida en el marco de unos mínimos morales exigibles a cualquier persona (ética de mínimos) (2001, pp. 202-206). El espíritu hermenéutico, crítico y dialógico que fundamenta la ética cívica, puede contribuir al desarrollo moral de los profesionales de la ingeniería, con la intención de adaptar la investigación y la innovación a las necesidades de la ciudadanía y, por tanto, favorecer la generación de un ecosistema europeo de IA inspirado en la confianza.

La ética aplicada a las profesiones debe honrar la conciencia moral alcanzada en nuestro tiempo y aceptar como referente una ética compartida, por tanto, la educación moral en el espacio de la ingeniería debe asumir el influjo de un pensamiento ético y cívico que es fundamental para la convivencia en las sociedades modernas. Una apuesta de este tipo implica el reconocimiento y compromiso con los valores que integra Cortina en la ética cívica: libertad, igualdad, solidaridad, respeto activo1 y predisposición al diálogo (Cortina, 1994; Cortina et al., 1996, pp. 27-38).

A pesar de que la ética cívica lleva a cabo un reconocimiento de la dignidad de todas las profesiones en términos de igualdad, es conveniente señalar que, en función de su contribución a la sociedad, no todas poseen el mismo grado de responsabilidad (Martínez Navarro, 2006, p. 12). Especialmente la ingeniería ofrece un servicio indispensable a la sociedad y contribuye a su modernización, por eso, sus profesionales realizan una tarea particular a la que hay que prestar especial atención. La particularidad de la ingeniería reside en la relación que mantiene con la técnica, pues esta es concebida como un medio y un fin, razón por la cual los ingenieros son considerados los técnicos por excelencia (Gómez-Senent, 2000).

En el caso específico de la ingeniería implicada en la IA no es suficiente una ética profesional ensimismada que determine cuáles son las buenas prácticas, pues los desafíos de las sociedades tecnologizadas exigen la definición de estas prácticas de un modo inclusivo y participativo, reconociendo la existencia de un conjunto de afectados por la profesión. Un reconocimiento que conlleva la aceptación de los afectados como interlocutores válidos y la atención a sus necesidades, a la vista de un referente ético compartido esencial para cuidar la convivencia en las sociedades pluralistas (Martínez Navarro, 2006, p. 7). Tan pronto como la ética profesional de la ingeniería haya estimado el conjunto de valores de la ética cívica y adaptado los bienes internos de su profesión, es importante explorar qué medios son los más adecuados para contribuir al cultivo de la confianza en el campo de la IA, y aquí es donde interviene el rol de la educación para incentivar el compromiso ciudadano.

La asunción de un compromiso serio con el contenido axiológico de la ética cívica favorecerá la generación de un ecosistema europeo de IA fundamentado en la confianza, haciendo, de ese modo, a la sociedad civil, partícipe de la investigación y la innovación mediante mecanismos de adaptabilidad práctica. La gestión justa y responsable de los sistemas artificiales a través de un equilibrio entre la aceptabilidad ética y la necesidad social, es posible si las profesiones técnicas, en este caso la ingeniería, en tanto que instituciones sociales, integran la ética cívica como uno de los pilares de su educación. En una sociedad plural como la europea, donde instituciones como la Comisión Europea y el Gobierno de España han manifestado un interés para asegurar la gobernanza responsable de la IA, es trascendental insistir en la riqueza de la ética cívica.

Las iniciativas políticas europeas y españolas que expresan su interés en la generación de un ecosistema de IA fundamentado en una perspectiva humanocéntrica, deben invertir mayores esfuerzos educativos para asegurar que las instituciones de educación superior cultiven los valores básicos compartidos, para que instituyan sociedades inclusivas, innovadoras y reflexivas.2 Como fue señalado en un apartado anterior, la meta singular de la educación respecto a la instrucción consiste en incorporar variables éticas que modelen la dimensión axiológica del carácter y la personalidad (Gracia Calandín, 2018, p. 76). En ese sentido, el cultivo y fortalecimiento de habilidades cívicas y democráticas en el entorno de la ingeniería constituye un acto de responsabilidad educativa que beneficia la cohesión social, fomenta un desarrollo científico confiable e inspira nuevas formas de sensibilidad y racionalidad (Gazmurri Barros, 2022).

Conclusión

El conjunto de las iniciativas de la Comisión Europea y el Gobierno de España representan un compromiso con la gobernanza ética de la IA. Si bien gran parte de los planteamientos de estas instituciones son una forma meritoria para establecer un ecosistema fundamentado en la confianza, carecen de una estrategia educativa concreta en el espacio de la educación superior. En particular, los estudios de ingeniería no disponen de elementos educativos suficientes en el área de la ética aplicada. Esta carencia dificulta la comprensión de los efectos controvertidos y ambivalentes de los sistemas sociotécnicos, al tiempo que disminuye el juicio crítico y la sensibilidad moral para reconocer una serie de aspectos que pueden ser desatendidos, como resultado del pensamiento computacional y el aceleracionismo económico.

Es imprescindible que las propuestas para la gobernanza ética de la IA, sustentadas en una perspectiva humanocéntrica, reconozcan, en primer lugar, el valor educativo de la ética para los saberes técnicos y, en segundo lugar, integren herramientas intelectuales y habilidades de interacción fundados en la tradición ético-cívica en los planes de estudio. La digitalización ha motivado el surgimiento de nuevas vulnerabilidades que precisan un incremento de la reflexividad y la sensibilidad moral. Así pues, el impulso de la innovación educativa para generar espacios de encuentro entre los saberes técnicos y las humanidades debe estar muy presente en las iniciativas políticas que aspiren a la gobernanza ética de la IA y al fortalecimiento de sociedades inclusivas, innovadoras y reflexivas en Europa.